Pessoas novas em GPR-Arrays podem pensar que array-data significa mais da mesma coisa. Embora isso seja parcialmente verdade, existem outros detalhes que, se considerados, podem facilitar os seguintes estágios de carregamento, processamento e interpretação de tais dados. Esta nota pretende dar algumas dicas sobre o processo de recolha de dados e a posterior gestão dos dados recolhidos.

Volume e densidade de dados:

Um pequeno projeto 3D pode conter cerca de 5 GB de dados brutos no total. Não é um arquivo grande para os padrões modernos e fácil de transferir usando um cartão de memória. No entanto, do ponto de vista de segurança e processamento de dados, não é aconselhável colocar todos esses dados em um único arquivo. Por quê? Cartões de memória baratos são propensos a corrupção de arquivos durante a transferência, e isso pode ser especialmente problemático se os dados estiverem em um único arquivo e forem afetados de alguma forma não imediatamente perceptível pelo operador.

Consequentemente, recomendamos dividir até mesmo projetos pequenos em várias faixas paralelas (se possível). Além disso, o volume de dados é linear à distância do ponto, onde metade da distância do ponto significa o dobro do volume de dados. Geralmente, não há benefício em coletar dados com uma densidade maior que a metade do espaçamento do canal do array. Portanto, uma matriz com espaçamento de canal de 8 cm equivale a uma distância de ponto de 4 cm.

Navegação (nos dados):

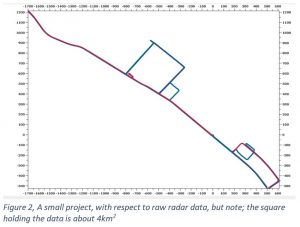

A Figura 2 acima mostra um projeto bastante pequeno, no que diz respeito aos dados brutos do radar (aprox. 4.5 GB), mas a interpretação de um projeto como esse significa navegar de uma escala de km até alguns metros, o que coloca bastante alta demanda no software de processamento em uso.

posicionamento:

O posicionamento é, de longe, um dos maiores pontos de discussão sobre a coleta de dados de array. O uso de RTK-GPS de alta precisão é o método de posicionamento mais conveniente e eficiente e, por essas razões, tem preferência sobre o uso de estações totais. No entanto, esta conveniência torna-se ineficaz em áreas onde o sinal é interrompido, por exemplo, por cobertura de árvores, edifícios altos ou outros obstáculos aéreos. Em última análise, é o próprio ambiente de pesquisa que determina o método de posicionamento a ser usado. Para as descrições a seguir, é importante observar que apenas RTK-fix é suficiente e que qualquer perda de RTK-fix causará trabalho extra no gerenciamento de dados.

Às vezes, é possível salvar um projeto com mau posicionamento; no entanto, se o projeto for grande com uma alta porcentagem de erros de posicionamento, pode ser mais econômico fazer um novo levantamento com um melhor posicionamento do que gastar um tempo valioso tentando consertá-lo. Outra consideração importante que pode facilitar o processamento posterior é a escolha da densidade de posicionamento durante a coleta de dados, pois uma densidade muito alta pode causar trabalho extra. Se você não tem controle adequado sobre o processo de posicionamento, faz pouco sentido implantar em campo para coleta de dados.

Curvas acentuadas durante a coleta de dados:

Ao coletar dados em campo, é perfeitamente viável mover a matriz de uma maneira que produza uma curva acentuada, ou raio, ao longo da faixa coletada. No entanto, é uma boa ideia pensar no que esse tipo de manobra fará com o gerenciamento de dados subsequente. Conforme ilustrado na Figura 3, esse raio resulta em dados que são significativamente esticados ao longo do perímetro externo, enquanto são comprimidos ao longo do perímetro interno. Como isso pode afetar a imagem final depende de como os dados foram coletados. Por exemplo, se a distância do ponto for definida como 4 cm durante a coleta de dados e 8 cm durante a interpolação, pode funcionar, mas a interpolação para o mesmo tamanho de bin que a distância do ponto afetará definitivamente os dados. Portanto, é importante considerar esses fatores ao planejar uma pesquisa; se essas voltas forem inevitáveis, estruture a pesquisa de modo que os dados coletados nesses pontos não sejam os mais importantes para a pesquisa geral.

Buracos nos dados

O que acontece com as áreas não cobertas por dados de radar? Bem, o software moderno oferece alguma capacidade de interpolar dados em tais espaços vazios, mas às vezes aplicar a regularização pode ser uma escolha melhor. Independentemente da função teórica empregada, se os espaços vazios forem muito grandes, nenhum software poderá corrigi-los, e essas áreas serão inúteis para interpretação. Outra questão menos óbvia é que a função de interpolação/binning ocupa espaço de memória no computador de processamento, mas até que ponto depende do software de processamento escolhido. Um projeto como o mostrado na Figura 4 pode ser difícil de processar devido às áreas muito grandes, não preenchidas e fechadas. Claro, se optar por processar manualmente definindo as áreas para interpolar ('chunking'), pode sempre ser possível, mas isso é bastante antiquado.

A Figura 5 mostra um projeto com 4.5 GB de dados brutos de radar, o mesmo que o projeto mostrado acima na Figura 2. No entanto, o layout deste projeto é muito melhor no que diz respeito ao gerenciamento de dados, pois é fácil de navegar, não tem curvas fechadas, nem buracos nos dados.

Evolução

Mesmo com o melhor planejamento, um projeto do mundo real pode conter dados abaixo do ideal. Portanto, ao lidar com os volumes de dados de um sistema GPR-array moderno, é sempre aconselhável se livrar dos dados problemáticos o mais cedo possível. A próxima nota desta série tratará do tópico de QA/QC de dados e discutirá ferramentas úteis para a seleção e gerenciamento de importações de dados.

Para baixar este artigo clique aqui.

Para saber mais, explore página do Raptor e Página do Condor